Deepfakes

Quand l’IA endosse la blouse blanche du Pr Serge Hercberg (Nutri-Score)

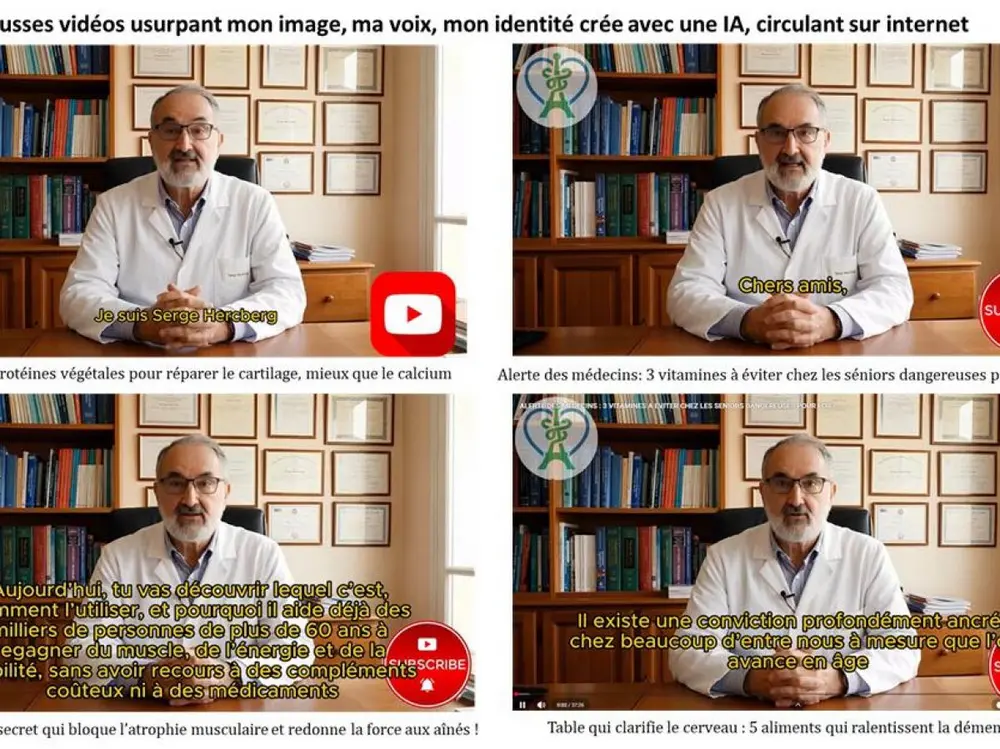

En ce début février 2026, le Pr Serge Hercberg, figure de santé publique en France et « père » du Nutri-Score, alerte sur LinkedIn : des vidéos générées par IA ont usurpé son identité pour diffuser des conseils nutritionnels pseudo-scientifiques, visant notamment les plus de 60 ans. Après Michel Cymes, Marine Lorphelin ou Jean-Michel Cohen, ce nouvel épisode montre que le deepfake ne cible plus seulement les « médecins médiatiques », mais aussi des scientifiques pur jus, pour conférer une crédibilité à de faux (et dangereux) messages en santé.

Pour les médecins belges aussi, la prudence est de mise et le réflexe doit être systématique : considérez toute vidéo 'trop crédible' comme suspecte, vérifiez-en la source et signalez-la immédiatement auprès de vos confrères. Car l’IA peut désormais emprunter votre identité aussi facilement que votre blouse blanche...

Pour les médecins belges aussi, la prudence est de mise et le réflexe doit être systématique : considérez toute vidéo 'trop crédible' comme suspecte, vérifiez-en la source et signalez-la immédiatement auprès de vos confrères. Car l’IA peut désormais emprunter votre identité aussi facilement que votre blouse blanche...

Le cas Hercberg: décor réaliste, discours inventé

Le mécanisme est rodé : blouse blanche (allant jusqu'au nom brodé!), faux cabinet et propos fabriqués de toutes pièces. Le Pr Hercberg décrit des vidéos le mettant en scène assis à un bureau « médical » inexistant, tenant des discours « plus ou moins ésotériques » sur l’effet d’aliments (style: "manger une pomme avec la peau nettoierait le cerveau"), nutriments ou comportements sur la santé osseuse et cérébrale des sujets âgés... Des propos qu’il affirme n’avoir « jamais tenus ».

Selon les éléments rapportés, l’émetteur serait une chaîne YouTube intitulée « Santé Sage », créée le 31 décembre 2025 et ayant publié plusieurs dizaines de vidéos, avant suppression du compte évoqué.

Quand la notoriété médicale devient une arme commerciale

Le phénomène n’est pas neuf : depuis plusieurs années, des deepfakes exploitent la confiance accordée à des médecins « connus et respectés » pour promouvoir des cures « miracle » (diabète, hypertension, douleurs articulaires…), allant parfois jusqu'à inciter à abandonner des traitements.

De précédentes victimes ont publiquement dénoncé ces montages, à l’instar de Marine Lorphelin (juillet 2024) ou du médecin urgentiste François-Xavier Moronval (septembre 2025).

Si les signaux d’alerte maintes fois cités demeurent utiles (désynchronisation lèvres/voix, clignements anormaux, variations d’éclairage), la progression rapide de la technologie complique de plus en plus l’identification...

Signalements, plateformes, droit : une riposte encore incomplète

Le Pr Hercberg indique avoir signalé les contenus via Pharos (site français de signalement de cybermalveillance, NdlR) et auprès de YouTube, tout en appelant à une « réponse juridique à de tels comportements malhonnêtes » et à une réglementation plus dissuasive.

YouTube rappelle que l’usurpation d’identité est interdite par son règlement et met en avant des outils de protection, dont « Likeness ID », destiné à repérer des vidéos où un visage a été généré ou modifié par IA, avec possibilité de demander un retrait. Les experts décrivent toutefois un rapport de force et un "jeu du chat et de la souris" entre fraudeurs et victimes, et soulignent l’intérêt de mécanismes de certification du contenu (signatures numériques) pour attester qu’une vidéo n’a pas été altérée.